Classement

Contenu populaire

Affichage du contenu avec la meilleure réputation depuis le 11/03/2026 dans Messages

-

Un technicien de Fibaro est intervenu aujourd’hui après lui avoir donné l’accès en activant Remote support, il a modifié la base de templates et après un soft reconfiguration des modules ils sont maintenant correctement inclus dans ma box avec le nouveau firmware. Envoyé de mon iPhone en utilisant Tapatalk4 points

-

There is no ready made function - you have to do it yourself. function QuickApp:iconCount(typ) local map = { [QuickAppBase.iconProviders.single]=1, -- single icon [QuickAppBase.iconProviders.binary]=2, -- off,on [QuickAppBase.iconProviders.multilevel]=11, -- 0%,10%,20%,30%,40%,50%,60%,70%,80%,90%,100% [QuickAppBase.iconProviders.baseShutter]=5 -- opening,opened,closing,closed,unknown } local iconProvider = QuickAppBase.deviceIconTypeMapping[typ] or "" return map[iconProvider] end function QuickApp:onInit() self:debug(self.name, self.id) print(self:iconCount("com.fibaro.energyMeter")) print(self:iconCount("com.fibaro.multilevelSwitch")) print(self:iconCount("com.fibaro.baseShutter")) end iconCount returns number of icons for a specific type. Currently there only seems to be 4 options, 1,2,5,11 icons. If it is not mapped (return nil), try with the device baseType and see if that is mapped. ...or Fibaro has forgot to do the mapping.3 points

-

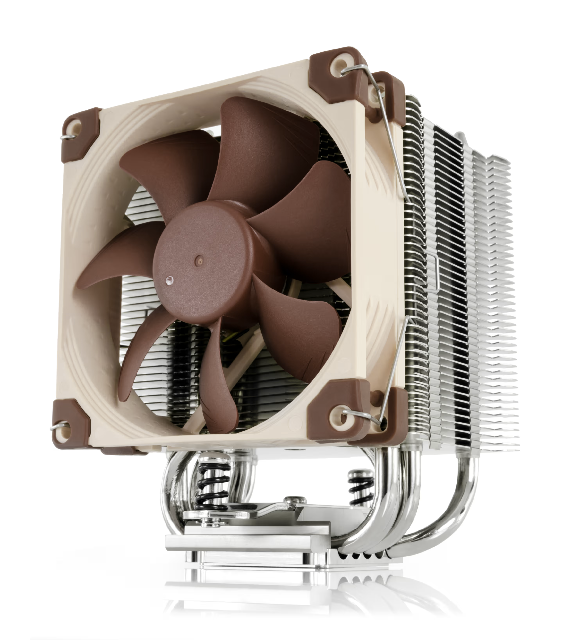

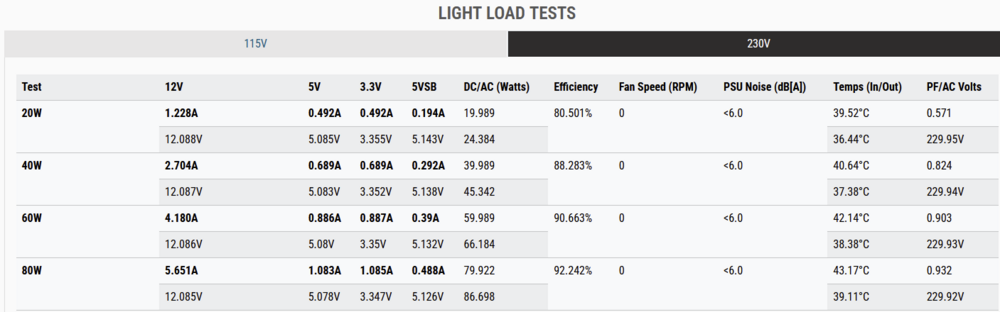

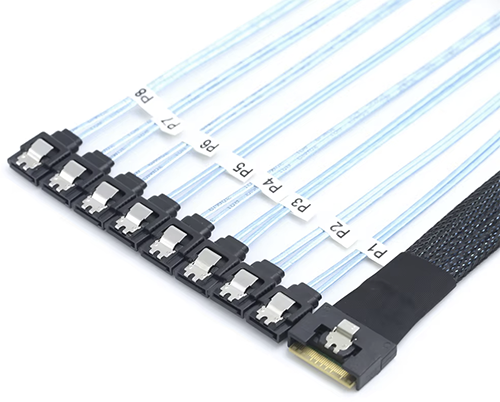

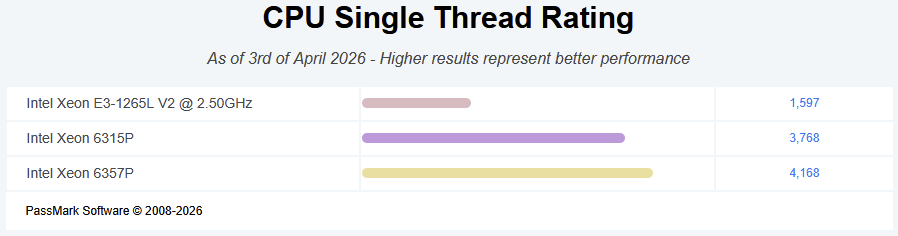

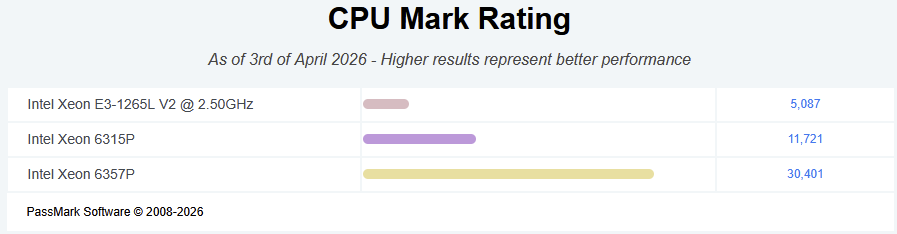

Choix des composants Processeur CPU Dès le début de mes réflexions j'ai voulu partir sur l'architecture Zen 5 de chez AMD, et tout particulièrement les processeurs AMD EPYC 4005 Grado. Leur force, c'est que pour le même prix que chez Intel, on a environ 2 fois plus de cœurs (utile pour la virtualisation, car plusieurs VM tournent en parallèle), et globalement 2 fois plus de performance. Cependant j'ai abandonné cette idée, à cause de la consommation en idle de ces processeurs. En effet, le point faible d'AMD à l'heure actuelle, c'est la consommation au repose, les processeurs ne sont pas capables de descendre aussi bas que les Xeon chez chez Intel. Et sur un homelab, les serveurs sont la plupart du temps inactif, donc ça aurait pas une consommation élevée inutilement. Je me suis donc tourné vers l'architecture Intel Xeon 6 sur socket LGA1700. Et plus particulièrement sur la série Intel Xeon 6300 de la famille Raptor Lake-S Refresh. Initialement je voulais prendre 3 processeurs identiques, mais je me suis dit que ce n'étais pas pertinent car j'ai 1 gros nœud (le NAS), et 2 nœuds secondaires, donc j'ai fait le choix d'équipe le 1er nœud d'un gros processeur, et les 2 autres d'un plus petit modèle, ce qui permet d'optimiser le cout mais aussi la consommation électrique : Nœud 1 NAS : Intel Xeon 6357P : 8 cœurs @ 3 GHz avec Hyperthreading - TDP 80W Nœuds 2 et 3 : Intel Xeon 6315P : 4 cœurs @ 2.8 GHz - TDP 55W Point important à prendre en considération, pour mon cluster il faut prendre 3 processeurs de la même architecture, c'est à dire partageant le même jeu d'instructions. Cela permet de déplacer une VM dynamiquement, à chaud, d'un nœud du cluster à un autre, sans arrêt/reboot de la VM. Dans le cas présent, la seule différence entre les nœuds sera le nombre de cœurs (et leur vitesse) qui diffère, donc aucun problème de compatibilité. Ces 3 processeurs ont été difficiles à trouver sur le marché, car ils sont normalement prévus pour les constructeurs OEM (tels que Supermicro, Lenovo, etc) qui les intègrent directement dans des configurations serveurs complètes. J'ai finalement pu trouver sur une boutique en Pologne, et l'autre en Angleterre en passant par les Pays-Bas. Comparé au processeur Intel Xeon E3-1265L V2 de mon micro-serveur HP Gen8 actuel, le gain de performance est significatif, pour ne pas dire énorme, que ce soit en multi comme en mono-thread, d'autant plus que j'aurai 3 machines prêtes à travailler simultanément dans le cluster : Mémoire RAM Pour le file-system ZFS qui sera utilisé dans TrueNAS, il faut de la RAM, beaucoup de RAM, car c'est sa capacité qui sert de cache disque, et donc augmente les performances. Comme pour les CPU, il est inutile de mettre la même quantité de RAM sur les 3 noeuds, j'ai donc choisi d'optimiser comme suit ; Nœud 1 NAS : 2 barrettes de 32 Go = 64 Go Nœuds 2 et 3 : 1 barrette de 32 Go = 32 Go Soit un total de 4 barrettes pour 128 Go de RAM, ce qui est plus que largement suffisant pour commencer, et je pourrai toujours doubler la capacité dans le futur si le besoin s'en fait sentir. A ce propos, j'ai choix la plus grosse taille de barrette disponible pour cette architecture de processeur, à savoir 32 Go, justement pour laisser des slots DIMM disponibles pour une extension future. Ainsi fini la frustration des 16 Go max du vénérable HP Gen8. La technologie imposée par Intel pour ces Xeon 6 est de la DDR5 à 4800 MHz au format Unbuffered UDIMM avec correction d'erreur ECC. Plusieurs fabricants proposent (enfin... proposaient... c'était dans le monde d'avant, en 2025, avant le délire de l'IA et de sa pénurie mondiale de composants...), j'ai retenu la référence Micron MTC20C2085S1EC48BR. Carte mère Impératif pour mon projet, la présence d'un port réseau dédié au management à distance du serveur (Power ON, OFF, remote control, montage d'ISO virtuel, etc). Concrètement, c'est la présence d'une puce ASPEED AST2600 avec IPMI, qui est l'équivalent de l'ILO sur les serveurs HPE. Ce qui élimine de facto toutes les cartes mères grand public, pour ne laisser que les gamme pro des fabricants, à destination des serveurs ou de certaines workstations. Après avoir comparé différentes marques et modèles (Supermicro, MSI, Gigabyte, ...) j'ai finalement retenu ASRock Rack (c'est la gamme pro de ASRock) car les modèles proposés convenaient à mes besoins et étaient disponibles sur le marché européen. Le choix du format a été dicté par le boitier (discuté ultérieurement) : Nœuds 1 NAS et 2 : ASRock Rack EC266D4U au format Micro-ATX Nœud 3 : ASRock Rack EC266D2I au format Mini-ITX Je ne voulais pas de réseau 10 GbE intégré sur la carte mère, car c'est systématiquement au format cuivre RJ45, et comme expliqué précédemment sur l'architecture réseau, la consommation électrique, et la chauffe, sont trop importantes. J'ai donc choisi des modèles avec uniquement des ports RJ45 1 GbE classiques, qui serviront pour l'administration, et pour les VM à faible traffic réseau sur les nœuds 2 et 3 (en dehors du NAS donc) Avantage de la carte Mini-ITX, elle dispose d'une entrée DC-IN 12V permettant de l'alimenter directement en courant continu 12V depuis ma batterie, sans passer par une alimentation ATX. Les autres critères de choix ont été le nombre et les vitesse des ports PCI-Express pour les cartes d'extension, M.2 pour le SSD NVMe de boot, et OCuLink pour le SSD de datastore et autres extensions futures. Boitier J'ai cherché des boitiers à monter en rack 19", on trouve quelques fabricants sur le marché, certains Américains ou Chinois qui sont plus ou moins difficiles à trouver en Europe, et c'est finalement sur SilverStone Technology que j'ai arrêté mon choix, car ils proposent un catalogue très large de modèles répondant à tous les besoins en terme de hauteur (U), de profondeur, mais aussi de disposition interne (plutôt orienté Stockage, GPU, Calcul, etc... selon les besoins) J'avais un impératif de limiter la profondeur à 50 cm pour rester sur un rack faible profondeur de 60 cm, et éviter de devoir utiliser un rack serveur pleine profondeur de plus de 1m comme on trouve dans les datacenters. Au final j'ai fait le choix suivant : Nœud 1 NAS : SilverStone RM41-H08 d'une hauteur de 4U qui accepte des cartes mères jusqu'au format ATX. Fourni de base avec une cage hot-swap pour 5 disques durs, et complété avec une cage SilverStone FS305-12G pour ajouter 5 disques durs supplémentaires, soit un total de 10 disques durs 3.5" hot-swap. Nœud 2 : SilverStone RM23-502-MINI d'une hauteur de 2U qui accepte des cartes mères jusqu'au format Micro-ATX. Et pour le 3ème nœud, celui qui sera déporté dans la maison, j'ai trouvé, non sans mal, un boitier parfait pour cet usage, ultra compact, dont le volume est 2 à 3 fois inférieur au micro-server HP Gen8 : Nœud 3 : Jonsbo NV10 Black au format Mini-ITX Ventirad J'ai choisi les ventirads en fonction de l'espace disponible dans chaque boitier pour optimiser le flux d'air et donc le refroidissement, avec une forte préférence pour les ventilateurs Noctua pour leur silence, leur durabilité, et leur faible consommation (même si ça ne se joue qu'à 1 Watt près) Boitier SilverStone 4U : Noctua NH-U9S Boitier SilverStone 2U : Silverstone AR09-1700 Ventilateur SilverStone d'origine remplacé par un Noctua NF-A6x25 PWM pour le silence Boitier Jonsbo Mini-ITX : Noctua NH-L9i-17xx chromax.black Ventilateur J'ai remplacé les ventilateurs d'origine des boitiers SilverStone car trop bruyant, même à faible vitesse. Et j'ai ajouté des ventilateurs dans les emplacements disponibles. La logique dans les boitiers serveurs est la même que dans tous les PC que j'ai monté depuis des années : plus il y a de ventilateurs, qui tournent à faible vitesse, mieux c'est pour le flux d'air et donc le refroidissement, mais aussi pour le bruit plus faible. J'ai choisi exclusivement la marque Noctua : Boitiers SilverStone 2U et 4U : Noctua NF-A8 PWM chromax.black.swap Noctua NF-A8 PWM Cages disques hotswap : Noctua NF-R8 redux-1200 Boitier Jonsbo Mini-ITX : Noctua NF-A4x10 PWM SSD Impératif pour mon projet, à cause de l'utilisation de CEPH qui réalise des écritures permanente sur les disques même sans activité, il me faut des SSD de classe enterprise, car disposant de la fonctionnalité PLP (Power Loss Protection). Cela élimine tous les SSD grand public, et donc logiquement ceux qui ont la mention "pro" dans leur désignation commerciale, coucou Samsung J'ai étudié différentes marques, Kingston, Micron, Solidigm (ex-Intel), Kioxia (ex-Toshiba), Sandisk, Seagate, Samsung (oui oui ils ont bien une gamme enterprise, donc non-professionnelle ), sachant qu'il me faut au minimum 2 SSD par serveur : 1 SSD NVMe au format M.2 à installer directement sur la carte mère pour le boot et l’installation de Promox. 1 SSD NMVe au format 2.5" à installer dans le boitier pour l'OSD de CEPH qui servira de datastore répliqué pour les VM. J'ai éliminé les SSD utilisant le protocole SATA (pourtant ça existe dans les gamme Enterprise avec PLP), car je cherche avant tout la performance et surtout la très faible latence, et seul le protocole NVMe, directement sur bus PCIe, permet cela. Au final, un peu comme pour la RAM, c'est la disponibilité des composants en fin d'année 2025 et les tarifs qui commençaient tout juste à s'envoler qui a dicté mon choix, notamment j'ai eu les 2 derniers Kingston disponible, donc j'ai ajouté un Micro pour compléter les 3 disques de boot : Boot Nœud 1 : Micron 7450 Pro MTFDKBA480TFR-1BC1ZABYY de 480 Go au format M.2 sur bus PCIe 4.0 x4 Complété par un dissipateur be quiet ! MC1 Pro Boot Nœuds 2 et 3 : Kingston DC2000B SEDC2000BM8/480G de 480 Go au format M.2 sur bus PCIe 4.0 x Avec dissipateur intégré Pour les 3 disques OSD pour CEPH, j'ai trouvé le même modèle : OSD CEPH pour les 3 nœuds : Micron 7500 Pro MTFDKCC1T9TGP-1BK1DABYY de 1.92 To au format U.3 sur bus PCIe 4.0 x4 Celui-là, c'est un monstre de performance et de fiabilité : garantie 5 ans, DWPD = 1 soit un TBW de 3504 To, dit autrement on peut écrire la totalité de sa capacité (1.92 To) chaque jour dessus pendant les 5 ans de garantie. La consommation électrique en revanche fait mal, 5W en idle, et 12.6W en pointe. L'imposant radiateur qui lui sert de carcasse annonce la couleur J'ai également ajouté des SSD SATA dans le nœud 1 NAS comme je l'avais expliqué précédemment : 3 x Samsung SSD 870 EVO SATA 2,5'' 4 To Pool local Proxmox VM TrueNAS : System Dataset VM Synology : Surveillance Station Pour connecter les SSD Micron au format U.3 sur les ports OCuLink de chaque carte mère, j'ai utilisé des câbles adaptateurs Oculink SFF-8611 U.2 SFF-8639 trouvés sur Aliexpress, qui se repiquent sur une alimentation SATA pour alimenter le SSD U.3 de la même façon qu'on alimenterait un SSD SATA 2.5" traditionnel : Carte réseau Ethernet Je l'ai expliqué précédemment, je veux des cartes réseau 10Gbit/s avec slot SFP+ pour y brancher des câbles DAC, évitant ainsi les ports RJ45. La plupart des forums recommandent les cartes Mellanox pour leur faible coût, mais j'ai préféré éviter à cause de leur consommation électrique importante, en effet ce sont de vieilles technologies. J'ai retenu les cartes Intel X710, ce n'est pas la toute dernière génération, mais c'est celle qui présente la consommation électrique la plus faible. Nœud 1 NAS : Intel X710-DA4 avec 4 ports SFP+ PCIe 3.0 x8 Nœuds 2 et 3 : Intel X710-DA2 avec 2 ports SFP+ PCIe 3.0 x8 Je n'ai pas acheté les Intel originales car le coût est trop important pour une valeur ajoutée que j'ai estimé nulle. Sur Aliexpress on trouve des clones pour une fraction du prix, surtout avec les promos du Black Friday. C'est le chipset X710 original de chez Intel, avec un clone du PCB, d'apparence, et fonctionnellement, elles sont identiques aux originales. Carte HBA SAS Elle est nécessaire pour connecter tous les disques durs à la VM TrueNAS sur le nœud 1 NAS. Ce n'est pas une carte contrôleur RAID, c'est uniquement une HBA (Host Bus Adapter), c'est à dire qu'elle présente les disques durs (ou SSD) tels quels au serveur. Elle supporte le hot-plug, ce qui s'accorde parfaitement avec les cages hot-plug à l'avant du boitier SilverStone. Sur bus PCI-Express, elle peut-être affectée en Passtrough PCI à la VM TrueNAS, ce qui est nécessaire pour les performances, mais aussi pour que ZFS puisse accéder directement aux données SMART de chaque disque. Note : ce n'est pas comme le mapping RDM de VMware, là c'est du vrai PCI Passtrough, c'est à dire que la VM à un accès direct à la carte et donc aux disques, et l'hyperviseur (Promox ici, comme le serait ESXi) ne voit pas du tout les disques durs. J'ai choisi le modèle suivant car c'est celui proposant la plus petite consommation électrique, notamment elle supporte l'ASPM ce qui permet de mettre le bus PCIe en veille et au processeur de descendre les C-States. Broadcom 9500-8i avec 8 ports SATA/SAS internes avec chip SAS3808 sur bus PCIe 4.0 x8 On constate qu'il n'y a que 8 ports alors que j'ai 10 emplacements disques, car le modèle 9500-16i était introuvable à prix descend, j'ai donc fait le choix du partir sur le modèle 8i car ça me suffit pour l'instant, on verra dans le futur pour la remplacer quand je trouverai la 16i à prix correct. Cela dit, comme pour les carte réseaux Intel, je n'ai pas pris la carte Broadcom originale qui est hors de prix, j'ai chois un clone (même chipset, clone du PCB) sur Aliexpress. Le site de Broadcom liste les câbles internes à utiliser selon ce qu'on veut brancher sur la carte, pour mon besoin j'ai utilisé un câble SlimSAS SFF-8654 to 8x SATA également trouvé sur Aliexpress pour une bouchée de pain. Alimentation Comme expliqué précédemment, les 2 nœuds en boitier SilverStone pour rack 19" sont alimentés par le secteur 230V, il faut donc utiliser une alimentation ATX standard. Mon objectif ici est de trouver l'alimentation avec le meilleur rendement possible, afin de minimiser les pertes de conversion, et donc d'énergie perdue. Je me suis d'abord intéressé au document suivant : PSU Low Idle Efficiency Database by Wolfgang's Channel Cependant, les meilleurs alimentations, les Seasonic Prime Titanium sont devenues introuvables (ou alors à des tarifs délirants), et la Corsair RM550x n'est plus fabriquée depuis longtemps. J'ai ensuite cherché sur le site de Cybenetics qui teste toutes les alimentations, et en particulier le tableau suivant : Cybenetics PSU Performance Database Qu'il faut classer par la colonne : Average Efficiency (20-80W) [%] Car c'est dans cette plage de puissance que les serveurs se situeront l'immense majorité du temps. J'ai donc choisi l'alimentation suivante pour chacun des 2 boitiers rackables : Cooler Master MWE Gold 750 V3 ATX 3.1 Contre toute attente, car c'est une alimentation certifiée seulement Gold, alors qu'on pourrait penser qu'il faut impérativement choisir des alimentation Titanium au minimum. Mais le truc, c'est que les serveurs vont travailler dans une plage de puissance très faible, c'est donc là tout l'intérêt du tableau cité au-dessus, de pouvoir filtrer sur la plage 20-80W. Le rapport Cybernetics complet pour cette alimentation confirme d'ailleurs les rendements dans les puissances les plus faibles, dans la section Light Load Tests : En plus cette alimentation a le bon goût d'être certifiée ATX 3.1, et même si ça ne m'est d'aucune utilité pour mes serveurs (pas de grosse carte graphique qui risque de prendre feu), c'est toujours bon à prendre. En ce qui concerne l'alimentation à courant continu 12V DC du boitier Jonsbo Mini-ITX, je ferai un post dédié plus loin.2 points

-

Cela fonctionne ou plutôt fonctionnait il y a un mois Il y a eu un petit souci il y a quelque temps suite a une modification de l'API mais depuis tout est ok Envoyé de mon Pixel 8 Pro en utilisant Tapatalk2 points

-

Alors celle-là, je ne l'avais pas vu venir, et c'est plutôt une bonne nouvelle, qui devrait enfin permettre au Zigbee de fonctionner correctement : [Domo-blog] Zigbee 4.0 : La fin de la bande 2,4 GHz et le futur de la domotique2 points

-

Firmware 5.202.54 BETA Hotfix 11/03/2026 Thank you for using our gateway! Be sure to update to the latest version to enjoy new features and improvements. Important notice: Version 5.202.54 is a hotfix for version 5.202.51. The update resolves: Fixed problem of the system hanging on Starting Services in rare cases when Thermostat Linked Device is used. Fixed problem that migration may fail when device model does not contain information about security level when devices were added in legacy versions. Main features: Migration of Z-Wave engine from 2.0 to 3.0 version (BETA) In this version of the software, it is possible to migrate the Z-Wave engine to version 3.0. Migration will allow you to take advantage of all the features of the new Z-Wave engine, including using Smart Start, better generic support for Z-Wave Plus devices and the availability of Security S2, which can be considered the first fully secure communication method for the Smart Home. Smart Start From now on, you can use the Smart Start function using QR Scanner in Yubii App. This function will allow you to add devices to the system even faster using binding process.*** What's new: Devices Added thermostatOperatingState interface for Linked thermostats. Added direct access to KNX communication (both sending and recieving packets) from the API. Gateway connection Enabling Support Access and Remote Access on the Master hub also enables access on slave hubs. Nice* Added the option to disable the sun impact (setting the value to 0 lux in parameter 10) for the Domi WSC device v3.9.0. The default values of parameters 1, 3, and 10 have been changed for all versions of DOMI WSC devices. Other Verification of the checksum when downloading the update file at the beginning of the process instead of at the end. Bug Fixes: Climate Fixed an issue where an added temperature sensor was removed from the climate panel when editing other settings in that panel. Fixes an error occurs after deleting a device in the climate schedule. Devices Fixed a problem with KNX device configuration caused by the lack of support for diacritical marks in device names. Fixed an issue with function settings for Z-Wave devices with an empty template during the binding process in the mobile application. Fixed incorrect KNX Bridge connection status after IP change. Restored missing temperature graphs on FGT device version 4.10. Fixed the appearance of the dialog in the user interface for BiDi-Awning and AV Controller. Elero Fixed color component values for the Elero Lighting RGBW device. Fixed the appearance and behavior of the Elero Lighting RGBW device icon in the user interface. Fixed invalid settings for temperature color in profiles for the Elero Lighting RGBW device. Gateway connection Fixed errors and incorrect display of options in association settings. Fixed IP address validation in the Gateway Connection tab. Nice* Fixed keep-alive support for Domi WSR/WS device, which caused the device to be shown as disconnected in the system. Other Fixed handling of events from the NICE camera plugin when devices are added via NVR. Fixed icons for Sonos and XBMC plugins. Fixed errors displayed in the Z-wave tab of the Master hub when using the interface via Remote Access. Fixed the input validator for variables. Fixed non-functioning group actions in profiles. Quick Apps Added support for climate zone control functions in QuickApps. Fixed restarting the Quick App process when editing it. Fixed Heat Activator which stopped working in rare cases. Fixed an issue with saving the Quick Apps view to a file when encrypting (applies to QA exported from version 5.191 or later). Scenes Fixed refreshing of the scene activity switch in the interface when calling activation/deactivation action from the scene level. Fixed inactive color temperature slider for device Elero Lighting TW in scenarios created in the mobile app. Known issues: Z-Wave Engine 2.0 to 3.0 migation Device updates from both the server and the file are not working, reconfiguration of the device resolves the issue. * - Does not apply to HC3L (Home Center 3 Lite). ** - Applies only to Z-Wave 3.0 engine. *** - Fully supported in the upcoming Yubii v2.5.3 application2 points

-

1 point

-

J'ai eu un peu les même problème. Ce que je vais dire n'engage que mes tests. J'ai remarqué que sur les zones de détections il vaut mieux mettre 2 points (Une ligne) Ta configuration d'espace ressemble au mien. 6 heures ce matin, je rajoute ce que dis la doc ------ (Facultatif) Modifiez la zone de déverrouillage et cliquez sur Enregistrer . Véhicule avec numéro de plaque d'immatriculation : Le véhicule doit être positionné à au moins 90 % dans la zone de détection pour une détection précise de la plaque. Seul le numéro de plaque d'immatriculation ------ J'ai mis immatriculation seule, car nous nous n'atteignons pas 90% du véhcule (un peu comme dans le store pour les personnes) Il y a aussi un paramètre qu'il ne faut pas toucher. C'est bien 5 secondes entre lecture des plaques (temps de déclenchement de l'IA sur une analyze). Ce soir, je suis arriver à ré-ouvrir automatiquement le portail. Bonne nouvelle, ma locataire est arrivé la nuit et cela a fonctionné(Précis car moi je ne vois rien). Attention car l'IA arrive à lire la partie département. Dans ce cas il faut rajouter sur une plaque déja existante la variante. En fait adapter ce qui se passe. Ma locataire ce soir est sortie et il a fait une détection de plaque avec AA23400 au lieu de AA234DD. Je l'ai rajouté sur son nom. Je pense que l'on peux descendre la sensibilité. Mais plus facile de faire cela que de tatonner. Voila mon retour pour l'instant1 point

-

Je viens de recevoir le G6 entry pro Il a toutes les fonctionnalités du G6 entry avec en plus - un annuaire des personnes sur un écran - ouverture possible avec un code pin - possibilité de créer un QR code pour autorisé l'ouverture - Une résolution bien plus importante (12m pixel) Mais je ne sais pas pourquoi je n'arrive pas a ouvrir mon portail avec la reconnaissance de plaque, alors que cela fonctionnait bien avec le G6 Entry?1 point

-

1 point

-

1 point

-

The types mapped in QuickAppBase.deviceIconTypeMapping by Fibaro are: com.fibaro.powerSensor com.fibaro.heatDetector com.fibaro.windSensor com.fibaro.windowSensor com.fibaro.rainDetector com.fibaro.gasDetector com.fibaro.player com.fibaro.genericDevice com.fibaro.humiditySensor com.fibaro.multilevelSensor com.fibaro.energyMeter com.fibaro.motionSensor com.fibaro.deviceController com.fibaro.rollerShutter com.fibaro.baseShutter com.fibaro.multilevelSwitch com.fibaro.doorLock com.fibaro.temperatureSensor com.fibaro.fireDetector com.fibaro.doorSensor com.fibaro.binarySensor com.fibaro.coDetector com.fibaro.floodSensor com.fibaro.binarySwitch com.fibaro.smokeSensor This means that we can upload iconsets for these types (and probably super types that has these as base types) If not mapped we can at least assign a single icon to them.1 point

-

1 point

-

Bonsoir, Voici la dernière version (1.3.0) qui permet de : sauvegarder les icônes type Device, Room et Scene,, télécharger de nouvelles icônes pour pour chacun de ces 3 types, recharger les icônes du backup vers la HC3*, Changer les icônes par les dernières icônes téléchargées avec une tâche 'load' par type, Changer l'icône d'un éléments par une existante dans la HC3. J'ai aussi revu le mode d'emploi. * Je l'ai laissée même si elle n'est pas facile à utiliser. HC3IconManager U_ManualV1-04.pdf HC3IconMgrV1.3.0.py1 point

-

My name is Victor. My system looks like this: 1 HC3 Master 2 HC3 Slave 3 HC3 Slave Devices: 198 Scenes: 109 I'm still trying to believe in z-wave )1 point

-

1 point

-

Punaise le support sur hc2 marche encore 🥳1 point

-

tien nous informé qu'on sache si retourner en arriève dans un firmware d'un module est possible.1 point

-

Lazer, pour un secours à la maison, je le répète, c'est nickel. Pour les sites qui utilisent une appli Android pour faire du scanning, cela fonctionne parfaitement aussi, donc pour l'utilisation, c'est nickel ! Bien sûr que c'est nul pour des tas d'autres choses, par exemple si tu veux jouer. Mais la techno est devenu superbe tout de même, 3G dans une époque proche encore, on pouvait faire 50% de choses en moins. Donc oui je persiste, pour ces utilisations c'est déjà nickel1 point

-

mon idée serait encore plus simple : pourquoi ne pas avoir ta maison en double dans le village d'à côté ? Certes, cela présente un LEGER (pour toi ) surcout, mais la sécurité n'a pas (pour toi ) de prix !1 point

-

en lisant le titre, je me disais : "enfin une bonne nouvelle : Jeedom a mis la clé sous le paillasson.". En fait, c'est sous TON paillasson, ce qui en soit rest une bonne nouvelle.1 point

Ce classement est défini par rapport à Paris/GMT+02:00

.thumb.jpg.6b7e910c38d0ab3700563b59e465b3f8.jpg)

.thumb.jpg.aee55b628a76b2583087f7a731d22fc5.jpg)