-

Compteur de contenus

26 499 -

Inscription

-

Dernière visite

-

Jours gagnés

1 386

Tout ce qui a été posté par Lazer

-

Les API pour voir les types supportés : /api/quickApp/availableTypes /api/devices/hierarchy

-

Je n'ai pas le temps de vérifier, mais quelques pistes : Si tu as déjà un module de type portail/gate, il faudrait regarder dans son JSON quel est son "type" : Si c'est différent de ton Quickapp "portail avec retour d'information", alors l'astuce est d'exporter ton QA, modifier le type à la main le fichier FQA avec un éditeur de texte, puis le réimporter. Si le type est identique, alors ce n'est pas la bonne piste, il faut chercher du coté des autres propriétés pour voir ce qui peut être modifiée (en LUA et/ou via l'API) pour lui donner les bonnes caractéristiques.

-

GCE Electronics EcoDevices 3 - Gestionnaire d'énergie

Lazer a répondu à un(e) sujet de mprinfo dans GCE Electronics

Tel quel non il ne sera pas compatible, car l'API a complètement changé depuis l'IPX800 v5... que je n'ai déjà pas pris le temps d'intégrer. Le QuickApp est modulaire, un fichier main, et une librairie dédiée à l'interfaçage avec l'API des produits GCE, et c'est ce dernier fichier qu'il faudrait adapter. Donc du boulot en perspective.... mais de mon coté ce n'est pas prévu prochainement... désolé... Si quelqu'un a le courage de se lancer, ça serait top.- 6 réponses

-

- 1

-

-

- gestionnaire dénergie

- gce electronics

-

(et 3 en plus)

Étiqueté avec :

-

Plantage du forum et connexion impossible avec code EX145

Lazer a répondu à un(e) sujet de Lazer dans Annonces et suggestions

Merci, pour l'instant ça va on a un peu d'avance dans les comptes. Si j'héberge à domicile, il faudra juste que je prenne un abonnement pour l'envoi des emails, c'est pas très cher. -

Plantage du forum et connexion impossible avec code EX145

Lazer a répondu à un(e) sujet de Lazer dans Annonces et suggestions

Tiens, j'ai vu Octave Klaba aujourd'hui, le patron d'OVH Du coup, j'en profite pour vous dire que j'ai un peu avancé, j'ai réussi à redémarrer une instance du forum sur mon serveur à la maison, ce n'est pas encore 100% fonctionnel mais c'est en bonne voie. Car l'échéance du renouvellement de l'hébergement OVH c'est au 1er juillet, donc ça me motive, si on peut faire cette économie là, car ils ont sérieusement augmenté leurs prix ! -

GCE Electronics EcoDevices 3 - Gestionnaire d'énergie

Lazer a répondu à un(e) sujet de mprinfo dans GCE Electronics

Perso je passe mon tour car cette nouvelle version ne supporte pas toutes les extensions qu'on avait avant, et notamment le X8D qui me permettait d'ajouter des entrées numériques pour compteur à impulsion. Dommage, espérons que ça arrive plus tard....- 6 réponses

-

- gestionnaire dénergie

- gce electronics

-

(et 3 en plus)

Étiqueté avec :

-

Top ça Si je bascule mes caméras sur UniFi, je prendrai le nouveau Network Video Recorder G2... plus cher mais plus puissant et embarquant des fonctionnalités qui nécessitaient un module externe avec la gamme précédente, notamment l'AI Key.

-

Quick App - Xiaomi Roborock Vacuum

Lazer a répondu à un(e) sujet de Lazer dans Quick App Developpeur

On constate que "water_box_status" a toujours la valeur 1 sur ton robot, même avec le réservoir vide. On dirait bien qu'à cause de la présence du dock, le robot considère que son réservoir n'est jamais vide, certainement car il peut aller se remplir tout seul. J'ai trouvé ceci qui donne les valeurs pour "dock_error_status" : https://github.com/copystring/ioBroker.roborock/issues/36#issuecomment-1408613528 "dock_error_status": 0 => All OK. "dock_error_status": 34 => Charging station blocked during automatic emptying. Dustbin, filter, or air duct is clogged. Check and clean the components. "dock_error_status": 38 => Hall sensor for clean water tank triggered. Check if the clean water tank is correctly inserted or refill it as recommended. "dock_error_status": 39 => Check the dirty water tank. Check if the dirty water tank is correctly inserted or empty it as recommended. "dock_error_status": 46 => Dustbin not installed. Reinsert the dustbin with the bag and try again. Il faudrait faire d'autres tests avec le réservoir plein/vide, et de même pour le dock, afin de voir comment évolue la valeur de "dock_error_status", peut être que c'est la bonne piste, mais peut être pas. Et ensuite, faire des modifications qui vont bien dans le code source du QuickApp.... si tu as le courage, désolé mais de mon coté je ne vais pas avoir le temps de le faire. -

Top, bien vu, c'est exactement ça Merci pour le partage

- 12 510 réponses

-

- support

- script lua

-

(et 1 en plus)

Étiqueté avec :

-

Aucune idée.... mais l'absence de template/modèle, ce n'est pas le problème. Le problème, particulièrement avec les modules Qubino Fil Pilote, c'est le firmware buggé qui ne répond pas correctement aux requêtes lors de l'interview initiale (inclusion). Donc j'ai quelques doutes sur la prise en charge de ces modules... là est la question.

-

-

Il y a un article intéressant et bien détaillé concernant les nouveautés de l'API liées au nouveau moteur Z-Wave v3 sur le forum officiel : [forum.fibaro.com] Z-Wave engine 2.0 -3.0 Migration. Changes in API

-

ça date, mais tu as vu ce message ? Sinon, on peut faire du MD5 dans les QuickApps sur HC3 à l'aide des librairies sha partagées par @tinman sur le forum officiel : https://forum.fibaro.com/topic/49113-hc3-quickapps-coding-tips-and-tricks/page/31/?tab=comments#comment-212984 Tu as un exemple d'utilisation dans mon QuickApp Xiaomi Roborock si tu es motivé pour fouiller dans le code source : En gros une fois que tu as importé la librairie sha dans ton QA, tu peux faire un (en tout cas c'est comme ça que je l'ai utilisé) : local key = sha.hex2bin(sha.md5(self.token))

-

Installée sans souci sur ma box de test

-

Quick App - Xiaomi Roborock Vacuum

Lazer a répondu à un(e) sujet de Lazer dans Quick App Developpeur

Merci pour le log détaillé, mais je vois que water_box_status = 1, ce qui indique que le réservoir est rempli. Sur mon modèle, j'ai bien 0 avec le réservoir vide. Donc si l'API de ton robot indique toujours 1 pour cette valeur, malheureusement impossible pour le QuickApp de savoir ce qu'il en est vraiment. Après, est-ce que c'est un bug, ou bien un changement de l'API sur ton modèle qui est probablement plus récent ??? (message "Attention : this vacuum model is unknown and may not be supported") Désolé mais là tout de suite je sèche un peu... -

Oui et ça fonctionne même déjà très bien

-

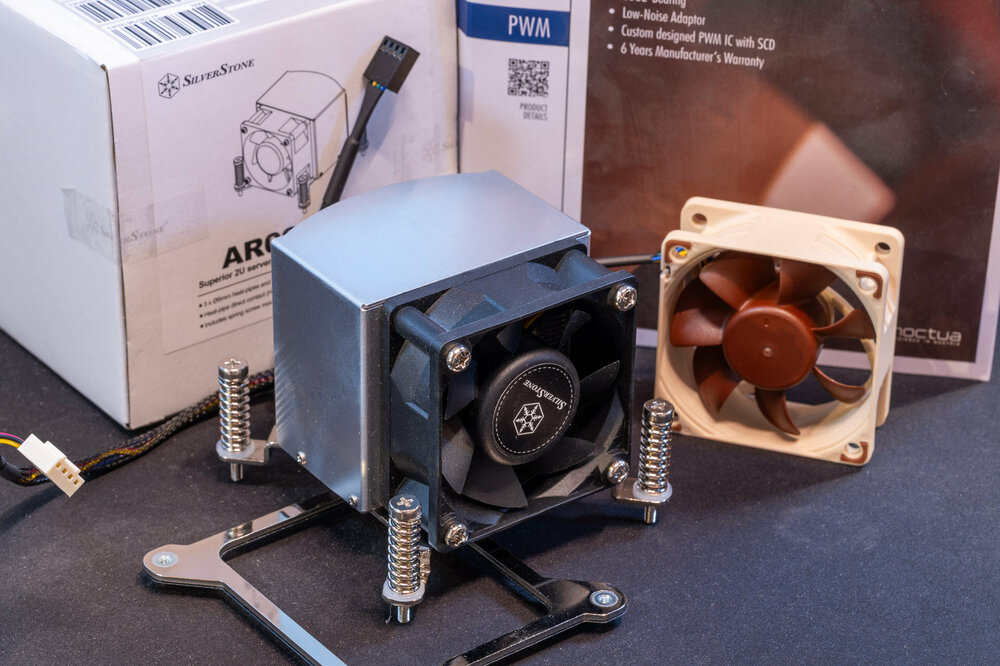

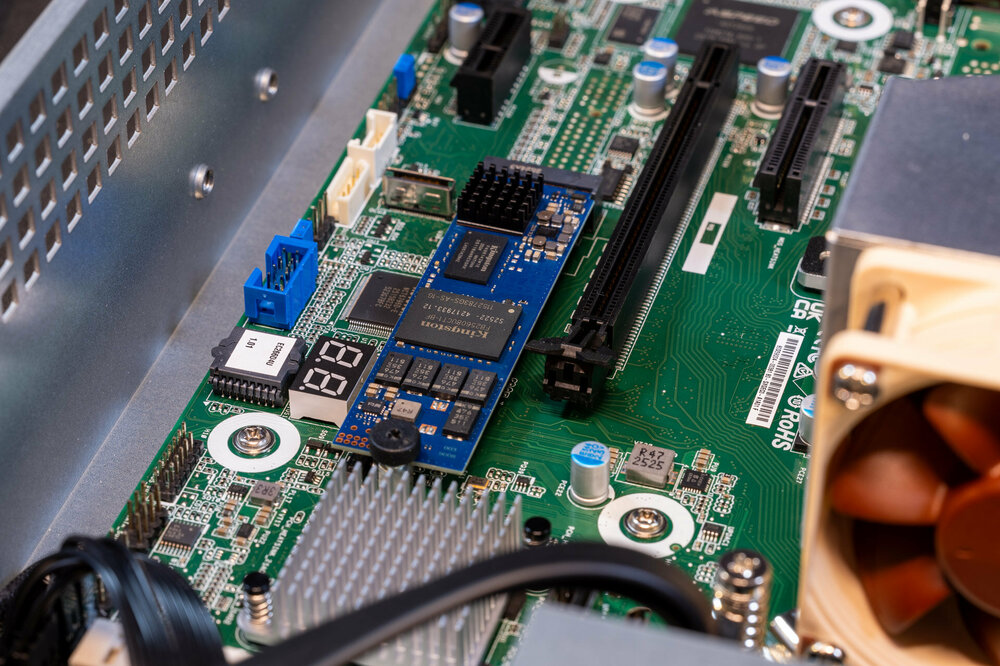

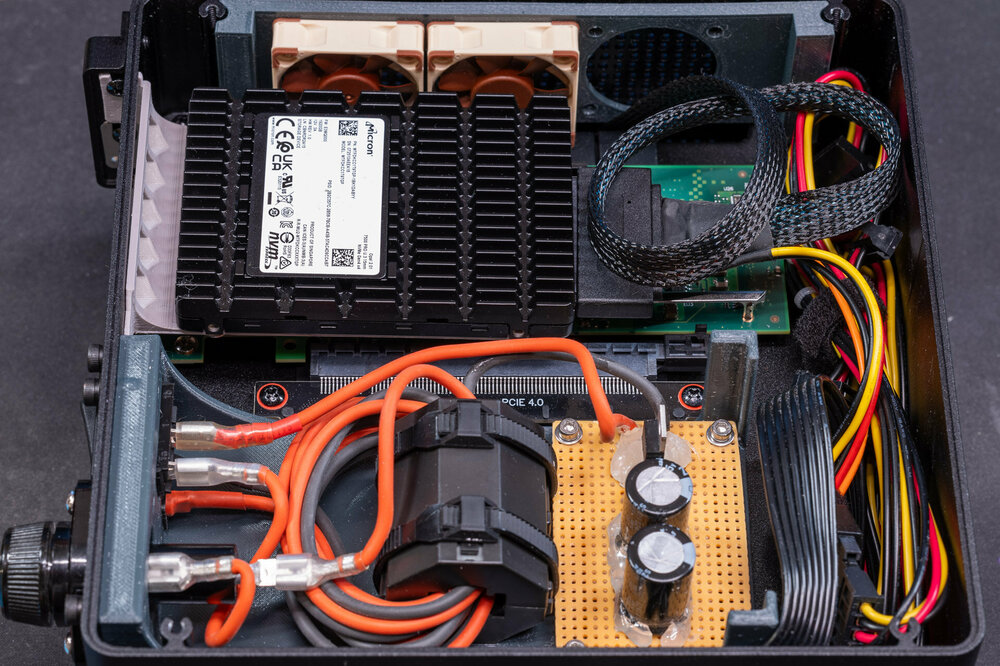

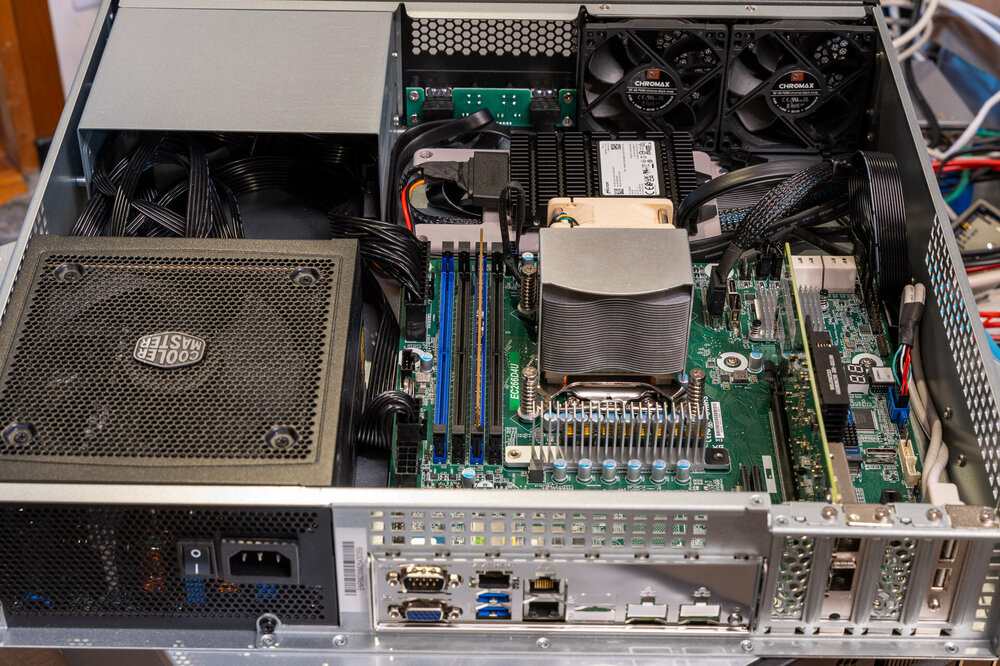

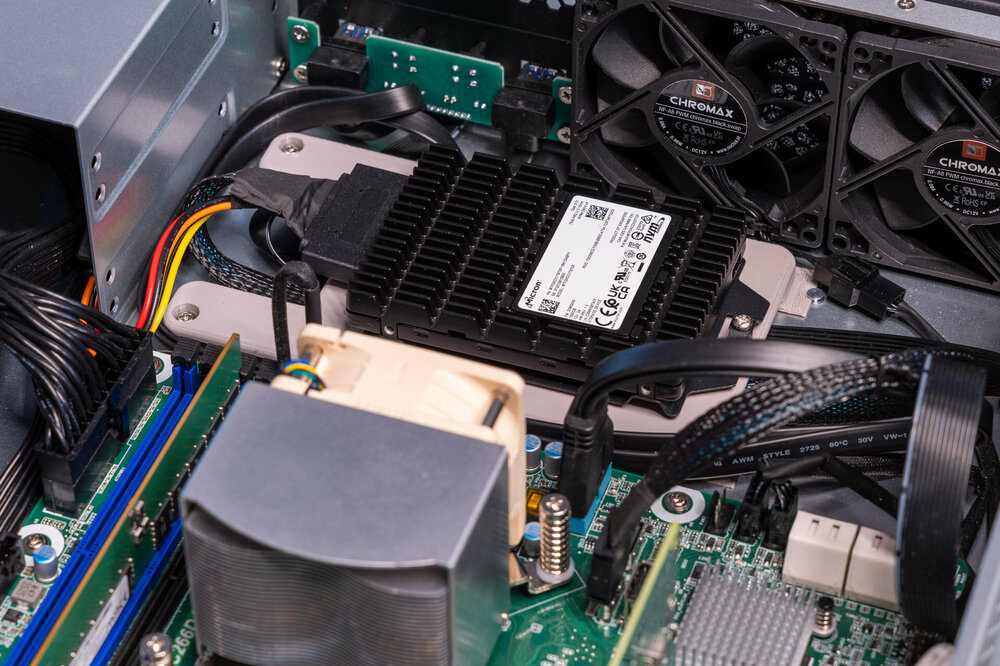

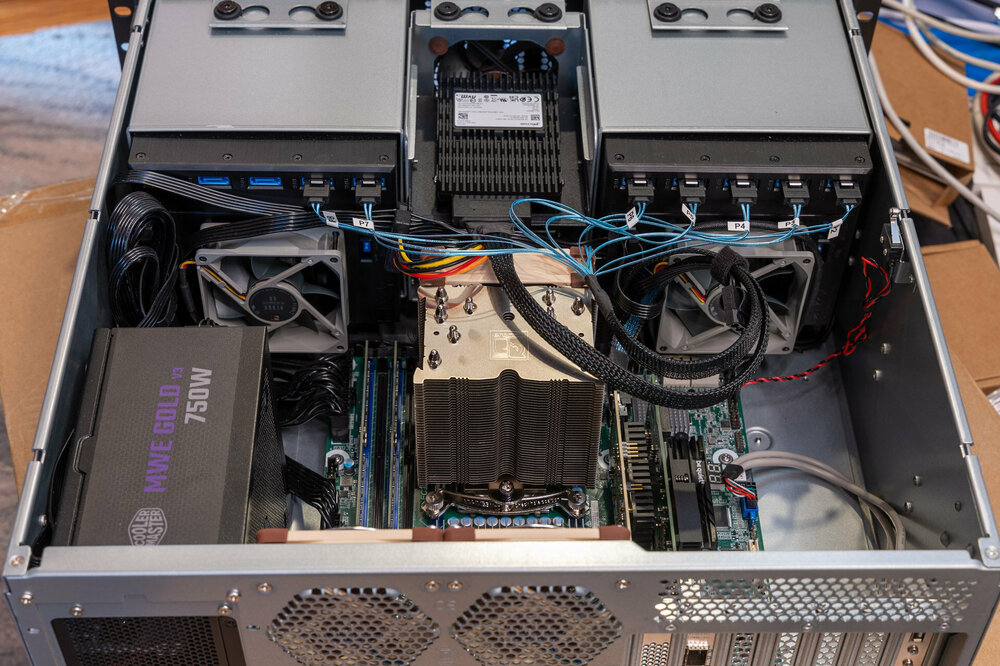

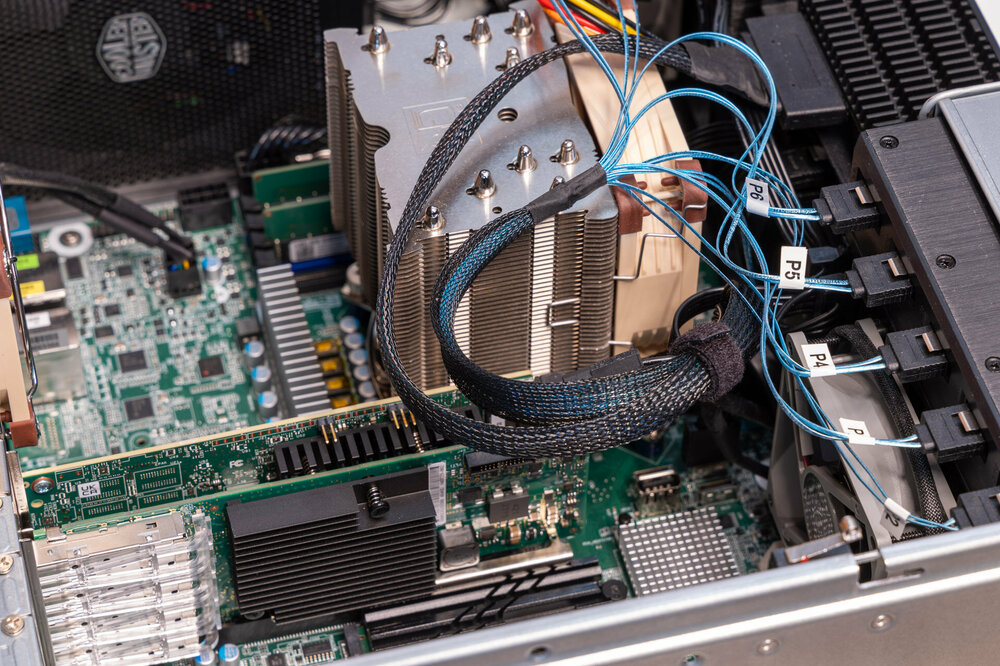

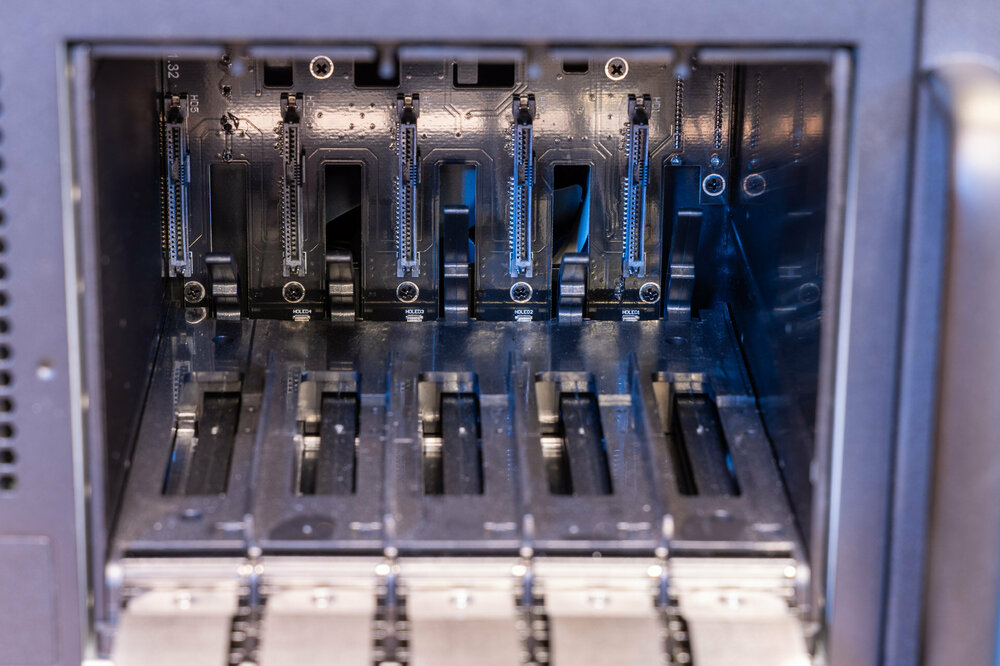

Montage Composants Les processeurs Intel Xeon arrivent dans des emballages individuels, se sont des versions "tray" normalement prévus pour l'intégration directe dans un serveur, donc pas d'emballage en boite marketing comme pour les processeurs grands publics : Les lingots d'or barrettes RAM DDR5 ECC (dont le prix a été multiplié par 5 entre l'achat et 3 mois plus tard, et elles ne sont carrément plus disponibles depuis) : Les SSD M.2 NVMe : Le ventirad SilverStone AR09-1700 faible hauteur destiné au boitier 2U, avec le ventilateur de remplacement Noctua NF-A6x25 PWM : Processeur Intel Xeon 6357P en cours de montage sur la carte mère ASRock Rack EC266D4U : SSD Kingston DC2000B installé sur la carte mère ASRock Rack EC266D4U dans le boitier 2U SilverStone RM23-502-MINI : Boitier 2U SilverStone RM23-502-MINI Vue de l'intérieur du boitier 2U SilverStone RM23-502-MINI, on voit le ventirad SilverStone AR09-1700 avec son ventilateur Noctua NF-A6x25 PWM, et la carte réseau Intel X710-DA2 : Vue arrière du boitier 2U SilverStone RM23-502-MINI, qui permet de voir l'alimentation Cooler Master MWE Gold 750 V3 ATX 3.1 qui fonctionne en passif à faible charge, et dont l'extraction de l'air chaud se fait par une grille percée dans le capot supérieur du boitier : Détail de l'intérieur du boitier SilverStone RM23-502-MINI, permettant de visualiser le SSD Micron 7500 Pro au format U.3. Ce boitier est livré avec une cage disque que j'ai retiré car elle faisait obstruction à l'un des 2 ventilateurs Noctua NF-A8 PWM chromax.black.swap. J'ai imprimé en 3D un support pour ce SSD en PETG gris afin de fixer solidement le SSD tout en lui assurant un refroidissement optimal : Boitier 4U SilverStone RM41-H08 Vue avant permettant de voir les 2 ventilateurs d'extraction arrière Noctua NF-A8 PWM (qui remplacement les ventilateurs SilverStone d'origines trop bruyants), ainsi que le SSD U.3 Micron 7500 Pro en premier plan. Cette cage disque interne comporte 2 autres SSD SATA Samsung 870 EVO non visibles sur les photos. J'ai également ajouté 2 ports USB sur équerre PCI à l'arrière parce qu'il y a des ports disponibles sur le carte mère, donc pourquoi pas : Vue permettant de visualiser les 2 cages disques hot-swap SilverStone FS305-12G (1 seule est fournie de base avec le boitier) dont j'ai remplacé les ventilateurs SilverStone d'origines trop bruyants par des Noctua NF-R8 redux-1200 : Vue permettant de voir le ventirad Noctua NH-U9S, la carte réseau Intel X710-DA4, la carte HBA SAS Broadcom 9500-8i, ainsi que son câble pieuvre SlimSAS SFF-8654 to 8x SATA vers les différents disques : Vue avant du boitier SilverStone RM41-H08 montrant le détail de la cage hot-swap SilverStone FS305-12G pouvant contenir 5 disques durs, ainsi que la cage hot-swap Icy Dock ToughArmor MB411SPO-1B contenant un SSD Samsung SATA 870 EVO : Vue de l'intérieur de la cage hot-swap SilverStone FS305-12G afin de montrer les connexions SATA, chaque disque dur vient directement s'insérer dedans sans nécessiter d'adaptateur : Boitier Jonsbo NV10 Black Support des composants de protection de l'alimentation DC, réalisé en impression 3D en PETG avec inserts filetés : Bloc de protection DC complet, avec connecteur XT-90, interrupteur et porte-fusible en façade, et à l'intérieur la ferrite et la carte de protection électronique comportant les diodes et condensateurs. Après la photo j'ai emballé le connecteur externe XT-90 sur son câble avec de la gaine thermorétractable. On aperçoit également le câble d'alimentation CPU 8 pin qui va se brancher sur la carte mère : Dans la partie supérieure du boitier Jonsbo NV10, se trouvent la carte-mère ASRock Rack EC266D2I au format Mini-ITX, le ventirad Noctua NH-L9i-17xx chromax.black, le SSD Kingston DC2000B, et le riser PCI-Express déporté vers le dessous du boitier : Dans la partie inférieure du boitier Jonsbo NV10, on peut voir en premier plan le bloc support de protection d'alimentation DC (de la colle chaude permet de maintenir les composants en place sur la plaque d'essai à trous, ce n'est pas très esthétique mais ça garantie que ça ne bougera jamais). En peut également voir le SSD U.3 Micron 7500 Pro sur un support sur mesure en impression 3D afin de le faire tenir sur un emplacement PCI, juste devant la carte réseau Intel X710-DA2. En haut de la photo, sur le coté du boitier, une impression 3D permet d'ajouter des ventilateurs d'extraction forcée Noctua NF-A4x10 PWM. Il n'y en n'a que 2 sur la photo, mais je vais en ajouter un troisième car en pratique ça chauffe beaucoup à cause du SSD : Vue arrière du boitier Jonsbo NV10, on voit la carte réseau PCI, et le bracket PCI imprimé en 3D pour le SSD avec des ouïes de ventilation : Vue du boitier Jonsbo NV10 sous tension avec tous les câbles connectés, notamment les 2 câbles DAC à 10 Gbps : Comparatif de la taille des boitiers Empilement de : Switch UniFi Aggregation Switch UniFi Pro HD 24 PoE Boitier SilverStone RM23-502-MINI Boitier SilverStone RM41-H08 Vue arrière de : Boitier Jonsbo NV10 Black Boitier SilverStone RM23-502-MINI Boitier SilverStone RM41-H08 Pendant les premières semaines j'ai réalisé l'installation initiale des nœuds et la configuration du cluster dans un coin de mon bureau, on peut également voir un bien connu Microserver HP Proliant Gen8 (qui tourne sous Proxmox Backup Server pour l'instant). Ne pas faire attention au câblage réseau qui était très temporaire au moment de la photo, c'était lors de la toute première initialisation des noeuds avec uniquement les connexions IPMI (port de management intégré à la carte mère) sur un petit switch UniFi 8 :

-

Ah tu nous fera un retour d'expérience alors Tu vas utiliser quoi à la place de Surveillance Station ? Sinon on en avait discuté sur un autre topic, l'IA intégré aux caméras Hikvision est très bien, le souci c'est l'intégration avec les NVR du marché. Concrètement, ça ne s'intègre bien qu'avec les NVR de la marque, Hikvision. Le souci c'est que l'ergonomie de leurs NVR est bien naze, et encore je suis gentil... et que dire de l'application mobile.... c'est une interface d'un autre temps. Enfin c'est mon avis. Avec Synology Surveillance Station, dont l'interface est très bien, l'intégration est limitée, les événements IA ne remontent pas, et même quand tu arrives à faire fonctionner le truc c'est au prix d'une configuration assez complexe car il faut sans cesse jongler entre l'interface de Surveillance Station, et de chacune des caméras. Après, les autres solutions comme Frigate, Blueiris, etc, même problème avec en plus une interface moins sympa que Surveillance Station. Je ne vais pas faire la promo de UniFi ici, mais quand tu vois l'interface, l'intégration de l'écosystème, les fonctionnalités, les capacités de reconnaissance IA, c'est juste... comment dire... un changement de siècle. Après oui, c'est sûr que Hikvision a un catalogue bien plus large, c'est sans commune mesure, mais est-ce utile ? J'ai une seule caméra qui n'a pas d'équivalent, c'est un modèle à double capteur infrarouge+visible, que j'utilise pour surveille ma batterie, mais c'est un cas très particulier. En dehors de ça, les caméras de surveillance intérieure/extérieure, on trouve l'équivalent dans toutes les marques.

-

Merci pour le partage J'en profite pour faire 2 HS : - au boulot j'ai découvert dans une salle de réunion qu'on utilise des écrans Hikvision pour les projections en réunion, avec caméra intégré, connexion Teams, etc. Cette marque a un catalogue très large. - en ce qui concerne les portiers (et les caméras), si je devais faire évoluer mon installation, c'est vers UniFi que je me tournerais maintenant.... interfaces bien mieux finie, écosystème plus intégré que chez Hikvision.

-

Non pas à ma connaissance. J'ai cherché, je suis tombé sur des forums et vidéos Youtube de gens qui montaient des trucs plus ou moins similaires, dont un Ukrainien, parce qu'il explique qu'avec l'instabilité du secteur dans les conditions qu'ils subissent, il a utilisé une batterie pour alimenter son PC de travail (et éviter la double conversion DC/AC/DC d'un onduleur + alim ATX standard et donc les pertes et réduction d'autonomie que ça engendre) Certains ont monté des projets pour alimenter tout une batterie de nœuds Proxmox dans un rack, avec des alimentations USB-C. Mais rien de standard, rien de commercialisé. Je sais que le DC est parfois utilisé dans les rack télécom, mais là non plus rien de standard parce que chaque constructeur a son propre connecteur et sa propre tension... Pourtant, avec le développement des ENR et du stockage sur batterie, le DC pourrait bien avoir un avenir... c'est encore trop tôt aujourd'hui, mais ça viendra peut être dans les années (décennies ? ) qui viennent... Parce que dans une maison, si on déploie un réseau électrique DC, il y a plein d'appareils qui seraient naturellement compatibles... tous les appareils électroniques bien sûr, mais aussi l'éclairage LED, toute la domotique, etc...

-

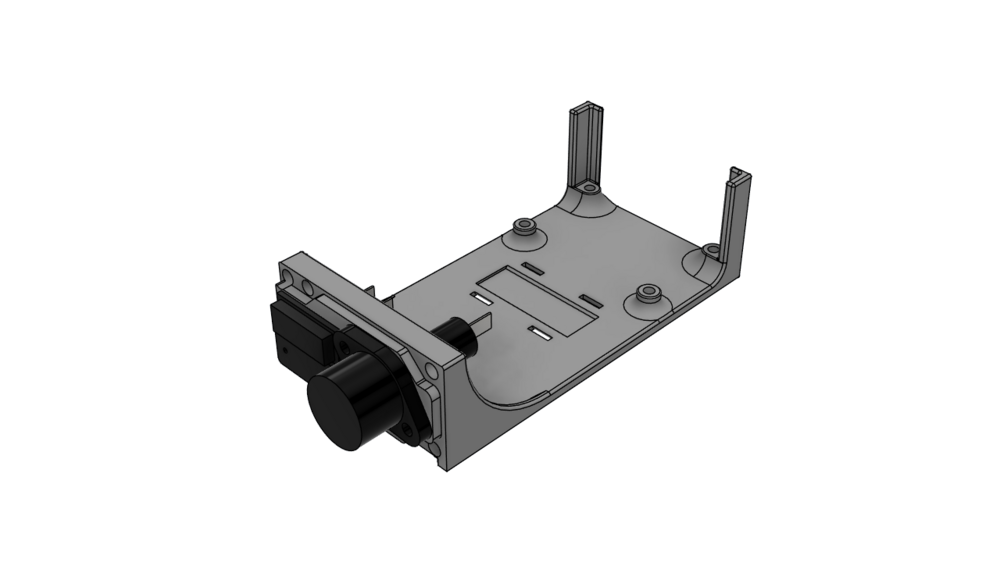

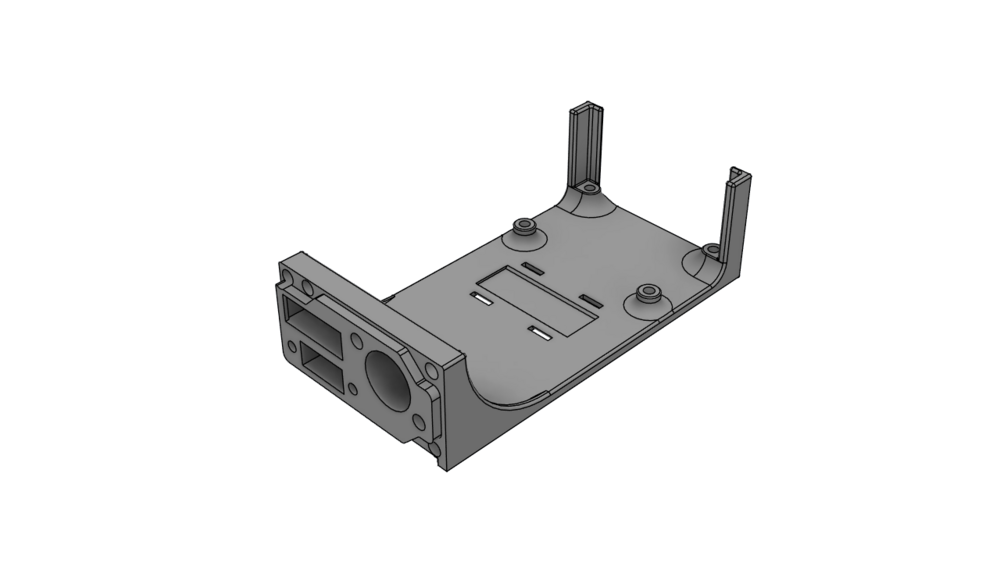

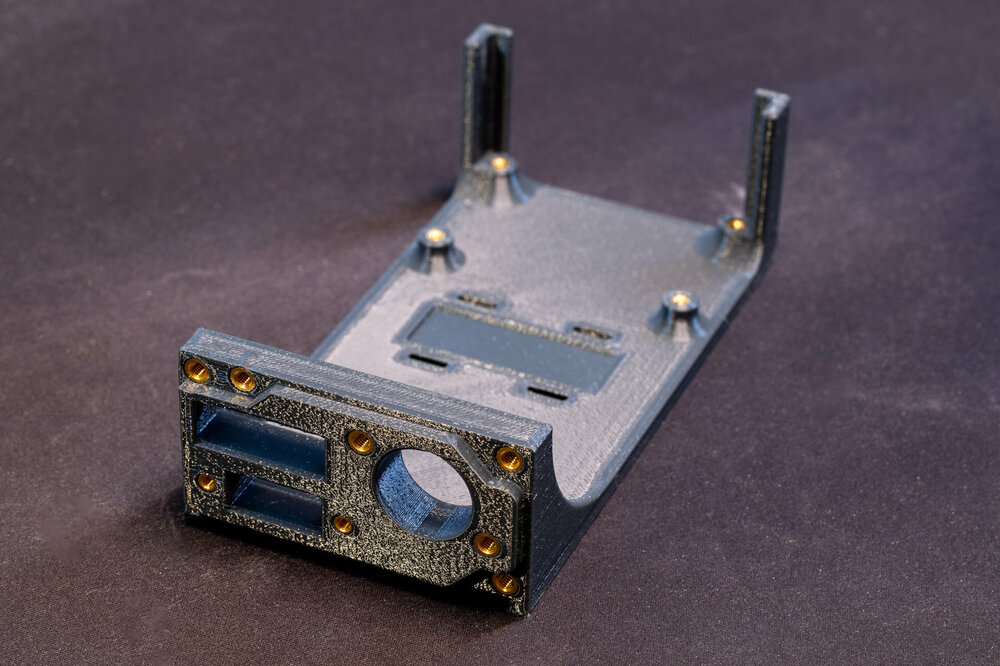

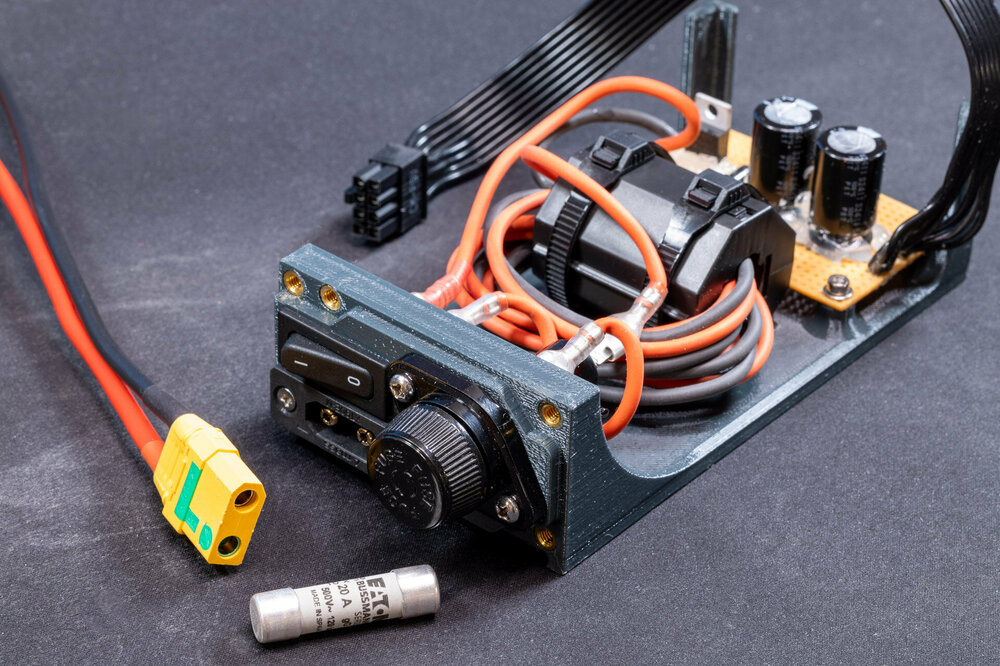

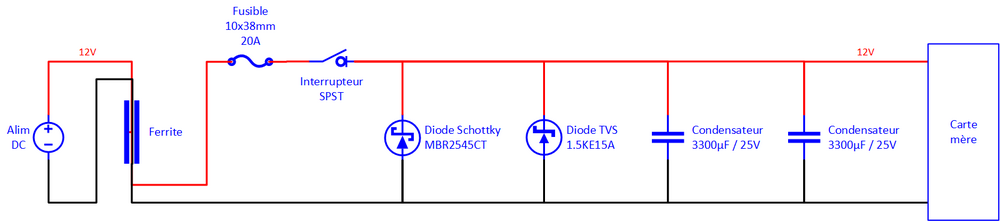

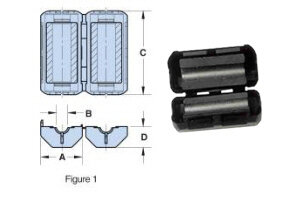

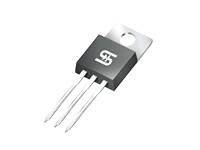

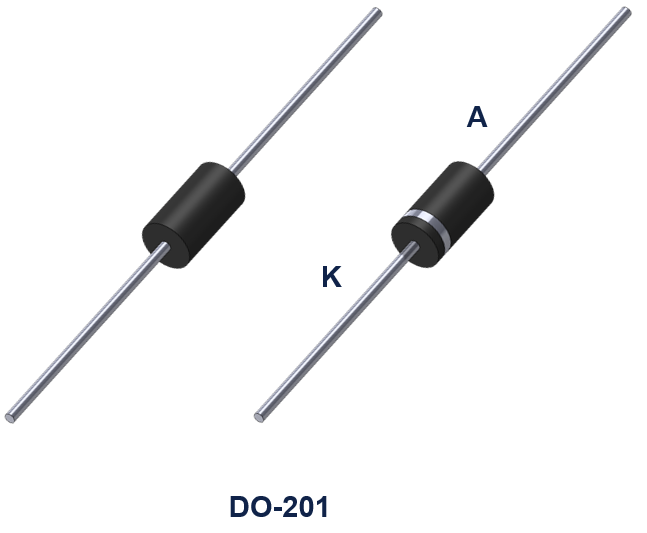

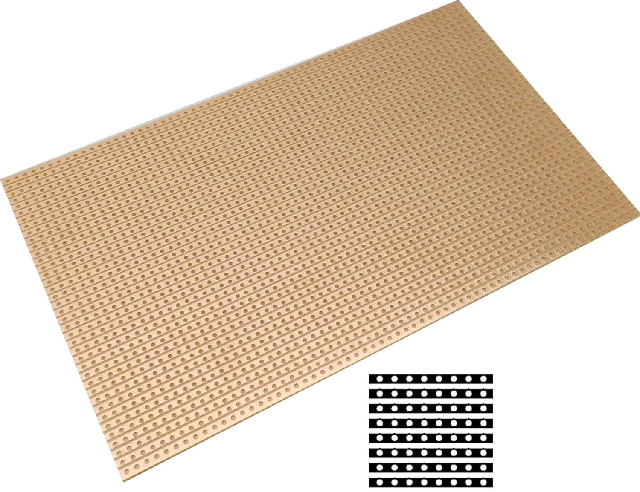

Alimentation à courant continu 12V DC Outre une alimentation ATX standard, la carte mère Mini-ITX AsRock Rack EC266D2I du nœud n°3 de mon cluster Proxmox accepte une alimentation DC-In en courant continu 12V. Convertisseur DC-DC Afin de convertir la tension batterie de 48V de mon système de stockage solaire vers du 12V accepté par la carte mère, j'ai choisi d'utiliser un convertisseur DC-DC de la même marque que mon onduleur car je suis convaincu qu'il s'agit de matériel de qualité, c'est à dire un Victron Orion CC-CC Tr, modèle 48/12 20A soit une puissance de 240 Watts. C'est largement surdimensionné, mais j'avais peur que le modèle du dessous de 110 W soit un peu juste pour tenir les pics de puissance du serveur (CPU et SSD notamment), au risque de provoquer une chute de tension, un reboot du serveur, et une usure prématurée des composants. Circuit de protection Avec ce convertisseur, et afin de protéger au maximum l'électronique sensible et couteuse de mon serveur, je veux sécuriser au maximum l'étage d'alimentation avant de rentrer dans la carte mère. Pour cela, j'ai préparé un schéma incluant différents composants : Ces composants sont montés dans le boitier du serveur à la place de l'emplacement normalement prévu pour l'alimentation 230V. Connecteur DC Tout d'abord, il faut un connecteur pour relier proprement le circuit externe au boitier du serveur. J'ai choisi le standard Amass XT90 qui est largement utilisé dans le milieu des drones de type racer car capable d'encaisser des courants importants sans chauffer et risquer de fondre. Il est capable d'encaisser des courant de 90A ce qui est largement surdimensionné. J'aurais pu me contenter du format XT60 inférieur, mais j'ai choisi de conserver le XT90 pour faciliter la soudure du câblage sur le connecteur avec les fils de 6mm² qui proviennent du convertisseur Victron. Coté boitier : Amass XT90E-M Coté câble : Amass XT90-S (c'est la référence Anti-Spark, c'est à dire anti-étincelle qui ce produit lorsqu'on branche le câble au moment où les condensateurs se chargent) Ferrite anti-parasite Premier composant du circuit, on trouve une ferrite dont l'objectif est le filtrage de mode commun du signal. En effet, le convertisseur Victron est une alimentation à découpage qui génère du bruit haute fréquence qui peut, à la longue, stresser les condensateurs de la carte mère ou perturber les signaux des différents bus du serveur. L'objectif est de faire passer ensemble les fils + et - à travers le gros anneau de ferrite agissant comme un filtre passe-bas qui bloque les parasites hautes fréquences venant du convertisseur DC-DC sans affecter le courant continu. J'ai choisi la référence Fair-Rite de diamètre 18.35 mm en Matériau 31, c'est complètement surdimensionné mais j'ai choisi en fonction de ce qui était disponible en stock, sinon il aurait été plus judicieux de choisir un modèle de diamètre inférieur. En pratique ce n'est pas un souci, car plus on fait de tour de fils dans la bobine, meilleure est la qualité du filtrage. Fusible Afin de protéger le système d'une consommation anormalement élevée de courant (court-circuit par exemple), j'utilise un fusible de 20A (ce qui fait 240W sous 12V afin d'être aligné avec la puissance du convertisseur Victron). Bien que cela ne soit pas indispensable (vu que le Victron est censé embarquer ses propres protections internes), je trouve qu'on n'est jamais trop prudent. En outre, ce fusible sert également en cas de mise en court-circuit par les diodes de protection qui sont décrites plus loin. Il s'agit d'un fusible aux dimensions de 10 x 38 mm monté dans un porte fusible Eaton Bussmann HPF dimensionné pour encaisser des courants jusqu'à 30A. C'est un gros porte-fusible, mais le piège aurait été d'utiliser un fusible de dimensions intérieures dans un porte-fusible qui n'aurait pas été capable d'encaisser de tels courants sans chauffer et fondre (et pourtant ça se vend.... ) Pour le choix du fusible, je suis resté dans la même marque avec un Eaton C10G20 commercialisé en boite de 10 (toujours avoir des fusibles d'avance... bon là j'en ai pour toute ma vie ) Interrupteur Ce n'est pas indispensable, mais c'est plus propre, un interrupteur SPST simple sur le + du circuit permet de couper le courant (similaire à l’interrupteur qu'on trouve derrière toute alimentation ATX digne de ce nom) J'ai choisi le Marquardt 1831.3313 capable d'encaisser le courant (même remarque que ci-dessus pour le porte-fusible et le connecteur DC) Diode de protection contre l'inversion de polarité C'est une diode Schottky de puissance qui se câble en parallèle du circuit entre le + et le -. En fonctionnement normal, la diode ne conduit pas. En cas d’inversion de la polarité, la diode devient passante (court-circuit franc) et fait griller le fusible 20A instantanément, protégeant le reste du serveur. Pour des raisons de stock sur les boutiques en ligne, j'ai choisi la référence Taiwan Semiconductor MBR2545CT, un peu surdimensionnée car capable de supporter 25A sous 45V, mais qui peut le plus peut le moins Diode de protection contre les surtensions C'est une diode TVS (Transient Voltage Suppressor) unidirectionnelle qui protège les composants sensibles du serveur contre une éventuelle défaillance du régulateur du Victron qui enverrait soudainement une tension supérieure à 12V. Si la tension dépasse 15V (ex: pic inductif ou panne Orion-TR), la diode devient passante instantanément et fait sauter le fusible, sauvant la carte mère. J'utilise la référence STMicroelectronics 1.5KE15A. Condensateurs de filtrage Le rôle du condensateur de filtrage est d'agir comme un mini-réservoir tampon juste à l'entrée de la carte mère afin de lisser le courant et absorber les pics transitoires, notamment lors des pics soudains de consommation du CPU ou du SSD. J'utilise 2 condensateurs électrolytiques en parallèle afin de doubler la capacité. J'ai choisi la très bonne marque japonaise Rubycon 25ZLH3300MEFC16X25 de la série ZLH à durée de vie élevée. Ce sont des modèles d'une capacité unitaire de 3300µF pour une tension de 25V ce qui offre une bonne marge de sécurité vis à vis des 12V du circuit, important pour la durée de vie des condensateurs, car c'est typiquement le genre de composants qui lâchent en premier dans un circuit électronique lorsqu'ils sont dimensionnés trop juste. De même, ils sont conçus pour fonctionner à une température de 105°C, ce qui offre une grosse marge par rapport à la température interne du boitier, augmentant d'autant leur durée de vie. En outre, il s'agit d'un modèle Low ESR (Faible Résistance Série Équivalente), c'est à dire que sa propre consommation est très faible et il est capable de livrer instantanément la puissance nécessaire en cas d'appel de courant. Câble de connexion carte mère Afin de relier la platine de protection électronique à la carte mère, j'ai coupé un câble CPU 8 pin que je n'utilisais pas de l'une des 2 alimentations Cooler Master MWE Gold 750 V3 ATX 3.1 que j'utilise sur les 2 autres nœuds du cluster. Sur ce câble, il y a 4 fils dédiés au +12V, et les 4 autres fils dédiés au 0V, qu'il suffit donc de souder sur les bonnes pistes de mon circuit. Ainsi, la connexion sur la carte mère se fait de façon sécurisée avec le connecteur Molex standard (détrompeur et verrou) Platine PCB Tous les composants sont montés et soudés sur une petite plaque d'essai à trou type Veroboard. Idéalement il aurait fallu faire graver un vrai PCB chez un prestataire dédié (n'ayant pas de machine à ma disposition), mais vu le coté unitaire du projet, j'ai trouvé cela superflu. Afin d'assurer la qualité malgré le coté bricolage du montage, je ne me suis pas contenté des pistes de cuivre de la plaque pour faire passer les courants importants en jeu. J'ai donc utilisé à la fois les fils des câbles d'entrée/sortie ainsi que les pates des composants diodes et condensateurs pour conduire le courant, tout cela noyé dans une importante quantité d'étain. Même si ce n'est pas très joli, la section du pâté d'étain est supérieure à la section des câbles, donc je suis tranquille. j'ai gratté les pistes de cuivre sur la plaque entre les poles + et - afin d'augmenter la distance d'isolation. Enfin, pour protéger le circuit des courts-circuit (objet qui viendrait en contact avec les pistes), j'ai noyé l'ensemble dans une résine silicone étanche. En outre, cela protège le métal de la corrosion, donc cela augmente la durée de vie du montage. Panneau imprimé en 3D Le boitier Jonsbo NV10 Black dispose d'un emplacement pour une alimentation au format 1U FLEX. Afin de monter proprement mon circuit de protection dans ce boitier, j'ai cherché les spécifications des dimensions sur Internet, qui sont identiques au format Flex ATX, puis j'ai dessiné un modèle afin de l'imprimer en 3D, pour supporter les composants de façade (connecteur, porte-fusible et interrupteur), et les composants internes. Des inserts métalliques (à entrer avec un fer à souder pour faire fondre le plastique) permettent une fixation propre et sécurisée de l'ensemble.

-

Malheureusement je ne pense pas que le hardware embarqué dans la station Netatmo permette d'héberger un serveur Web ou tout autre service (MQTT, etc) permettant de consulter les infos en local. Elle a été conçue il y a plus de 10 ans cette station. Après, "commercialement" parlant, à vrai dire je ne sais pas... le grand public, c'est à dire 99% des clients, se moquent pas mal de l'accès local, c'est malheureux mais de nos jours la plupart des gens trouvent normal d'acheter un produit jetable... ils veulent juste que ça remplisse sa fonction de base, c'est à dire juste afficher la température sur l'écran du téléphone (oui... c'est une station météo de luxe....) Les gens à qui ça ne plait pas, ils achètent une station météo Lacrosse avec un écran, ou Bresser, ou tout autre marque qu'on achète sur un coup de tête pendant la balade au Nature et découverte en famille le week-end. Ou qu'on offre à Noel ! Ou alors, c'est à dire le 0.1% de clients restants, ce sont des geeks, qui ont une box domotique et achètent des capteurs à pas cher sur Aliexpress (Zigbee, ESPhome, etc) Et puis faut pas oublier que le choix du Cloud est fait pas les fabricants pour des raisons de couts (économies d'échelle) c'est plus rentable de mettre un hardware sous-dimensionné dans un objet connecté (le vendre une fortune pour ce que c'est), gérer les mises à jour uniquement coté serveurs/cloud, et surtout : acquérir de la donnée !

-

Et il y a même pire, car ça me rappelle le plantage de Somfy il y a quelques années... en plus de ne pas pouvoir ouvrir les volets, les clients ne pouvaient même plus ouvrir la serrure connectée de leur porte d'entrée !!! Il me semble bien qu'il était arrivé la même chose aux clients Tesla qui ne pouvaient plus ouvrir (et donc démarrer) leur voiture le matin avec la clé numérique contenue dans le smartphone, car ça passe également par le Cloud. Bref, Cloud ou pas cloud, il faut toujours prévoir un accès local (ce qui n'est pas possible avec Netatmo...), on ne le répètera jamais assez

-

Non non, pas mauvaise langue, pour une entreprise internationale comme Legrand, ça fait tâche de ne pas avoir d'astreinte la nuit... Tombé samedi soir à 23h10, et effectivement c'est revenu depuis ce dimanche à 15:17 EDIT : je n'en étais pas certain, mais je viens de vérifier, Legrand est au CAC40 quand même.... quand je dis que ça fait tâche, le mot est faible...

-

Je viens d'aller voir sur mon compte Netatmo Developper en me disant qu'il faudrait créer un nouveau token, et bah c'est pire que ça : toutes mes applications ont disparues ! Je n'ai plus que le pluviomètre qui est dépendant de la station Netatmo, pour tout le reste (température, humidité, etc intérieur comme extérieur) j'utilise d'autres modules. Le Cloud, toujours le Cloud....

IsolatedDC-DCconverter.png.5ee4edca08dde7177ad710c28a6486a6.png)

-1000x1000.thumb.jpg.0fa83b7e5677b5feaf11fc65b87626cb.jpg)